人工智能(AI)正加速渗透日常生活的每一个角落,从智能手机的实时语言翻译、医疗领域的快速分诊,到智能穿戴设备的健康监测、数据中心的大规模算力运算,AI的每一次突破,都离不开高速、高效、高可靠的数据存储与传输能力作为支撑。当生成式AI爆发式增长,边缘AI快速普及,数据存储的容量、速度、能效与定制化需求迎来颠覆性变革。

AI计算平台升级,存储技术迎全新突破

AI技术的迭代,正推动计算平台需求的根本性转变——从单纯的分类工具,升级为计算密集度更高的生成用例,这一转变对硬件性能提出了严苛要求。

高带宽成为核心刚需:若存储系统的带宽无法匹配AI 场景下的海量读写数据量,极易形成性能瓶颈,导致数据加载、模型检查点写入等关键操作产生显著延迟,最终造成 GPU、CPU 算力空转等待,大幅降低算力资源利用率。

高读写速度是关键支撑:AI 训练过程中,存储系统内部的数据碎片化问题会直接导致连续数据块访问效率下降,引发读写延迟飙升,不仅增加数据处理耗时,更可能中断模型训练流程,影响研发进度与算力效能发挥。

低功耗是规模化部署核心要求:AI 算力集群多节点、高并发的运行特性,使得多进程与多应用会持续竞争存储资源,易引发存储争用问题;而低功耗的存储架构,既能在高并发访问场景下保持高效数据处理能力,避免因能耗过高导致的性能降频,适配规模化部署的实际需求。

边缘AI加速落地,终端存储需求再升级

人工智能应用的日益普及,随着人工智能开始迁移到PC、智能手机甚至汽车等边缘平台,存储和处理需求将会发生变化。隐私问题等因素推动了向边缘AI的转变,通过AI处理在设备本地中更有效地保护用户隐私,但这将极大地增加日常消费设备对内存和处理能力的需求。

随着AI应用从云端向边缘终端快速延伸,PC、智能手机、AI眼镜、智能手表等消费级设备正成为AI落地的核心场景,隐私保护需求的提升的更是加速了这一迁移进程,边缘AI通过本地数据处理,能更有效地守护用户隐私,但也对终端设备的存储容量、处理速度与功耗控制提出了更高要求。

AI 算力场景的理想搭档

随着人工智能向边缘发展,需要能够满足日益增长的密度、速度和效率需求的存储解决方案。NAND闪存技术在满足这些需求中发挥着关键作用,诸如TLC(三层小区)和QLC(四层小区)等创新进一步推动了容量极限。

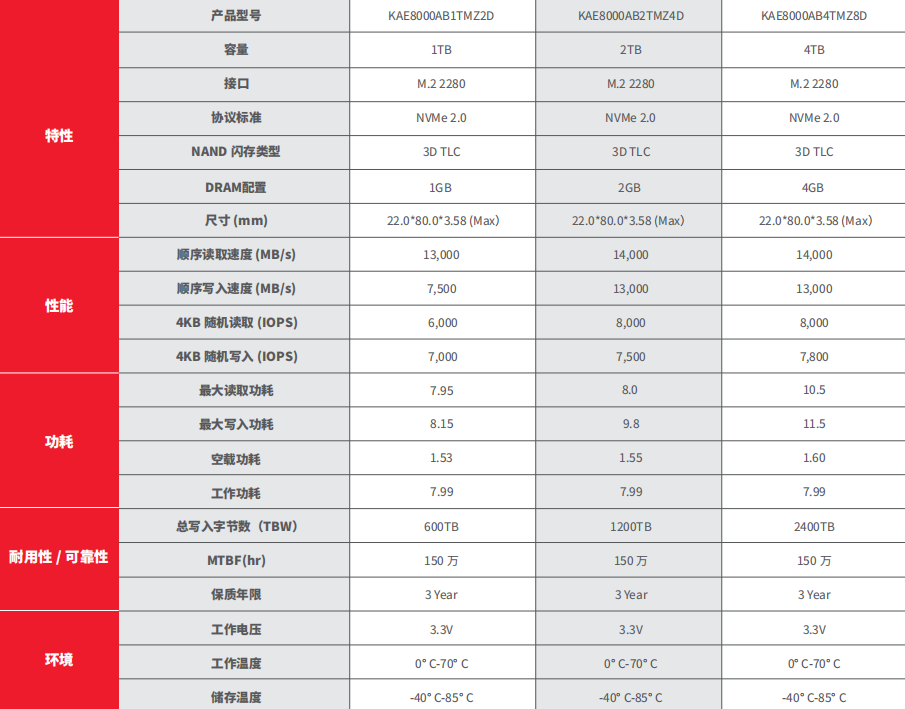

在高性能AI计算场景,KOWIN PCIe 5.0 SSD,以更高存储密度与高速缓存技术为核心优势,采用主流成熟主控方案,搭载3D TLC NAND,支持PCle Gen 5.0x4总线接口,符合NVMe 2.0传输协议,读写性能强悍。配载4K LDPC纠错算法,支持端到端数据保护,保证数据高可靠性和高兼容性。超快性能体验,顺序读取速度最高可达14000MB/s,顺序写入速度最高可达13000MB/s。1TB内存搭载1GB缓存,2TB内存搭载2GB缓存,4TB内存搭载4GB缓存,成为AI算力场景的理想存储搭档!可支持专业工作站、AI存储领域、服务器等AI 场景。

未来趋势

立足AI时代浪潮,云端存储将继续承担大规模AI训练的海量数据存储需求,聚焦高容量、高带宽的技术优化。康盈半导体将聚焦更高容量、更低功耗的产品研发方向,通过产品迭代满足AI 算力场景的需求。不断突破存储技术瓶颈,以更优质、更高效、更可靠的存储解决方案,助力AI技术在消费电子、智能穿戴、数据中心等各领域实现更大突破。

KOWIN PCIe 5.0 SSD产品参数

- 随机文章

- 热门文章

- 高速风机EMC整改:从测试到合规的一站式解决方案

- 无刷电机详解及其应用

- 猿声科技完成新一轮战略融资,柯力传感出手 看好多维触觉技术

- 如何通过USS协议实现变频器与PLC之间的通信?

- 这一重量级玩家入局,全景相机越来越卷?

- 扎牢防护篱笆,守卫数据安全:交通银行构建金融数据安全新范式

- 艾瑞咨询:京东618大小家电市场份额均超50% 品质电器增长亮眼

- 天创信用:十年砥砺前行,开启信用科技新征程

- “影”领夏日!超60部佳片来袭,暑期观影指南请查收→

- 小米电动汽车有望年底实现盈亏平衡,或推动评级上调

- 1感染甲流后该如何科学调养?饮食起居这样做,感染甲流后该如何科学调养?饮食起居这样做

- 2马克龙去的这所大学,太宝藏了吧!,马克龙去的这所大学,太宝藏了吧!

- 3北方多地迎来降雪降温天气 各部门联动“战”寒潮筑牢安全防线,北方多地迎来降雪降温天气 各部门联动“战”寒潮筑牢安全防线

- 4“无保护”攀岩真的无保护吗?“无保护”攀岩真的无保护吗?

- 5福州发布公告:吴石故居将封闭施工,展开系统性修缮

- 6城中话债|激活民间投资:让有效率的资本站上C位

- 7科学家的照片排在董事长之上,科学家的照片排在董事长之上

- 811月份“菜篮子”产品价格呈现季节性上涨 多因素推高生产成本,11月份“菜篮子”产品价格呈现季节性上涨 多因素推高生产成本

- 9晚间重磅!又一万亿级券商将诞生 券业并购潮涌

- 10何立峰:有力有序有效做好2026年金融重点工作